| Contact person: | Ralf Reulke |

| Staff involved: | |

Verkehrsbeobachtung ist hier definiert als die Erfassung und Verfolgung von Verkehrsobjekten von ruhenden und bewegten Plattformen. Die abgeleiteten Daten sollen Eingang in die Verkehrsmodellierung und -simulation finden. Ziel ist eine verbesserte Verkehrssteuerung. Im Kontext der Verkehrsbeobachtung ist die Erfassung von Form, Farbe und Position der Verkehrsobjekte von Interesse. Weiteren Informationsgewinn ergibt die Analyse und Interpretation von Bildfolgen oder Videosequenzen. Hieraus können zusätzliche Daten, beispielsweise Geschwindigkeit und Beschleunigung und damit generelle dynamische Eigenschaften von Objekten gewonnen werden.

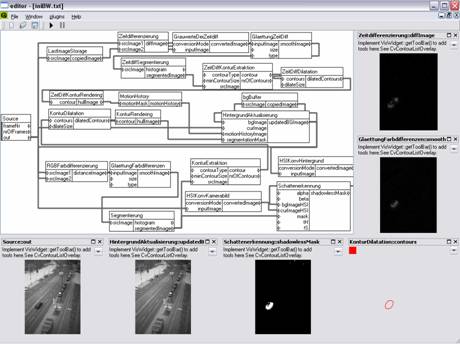

Für die Objektsegmentierung wird eine graphische Entwicklungsumgebung verwendet. Dazu wurde ein graphenbasierter Ansatz umgesetzt, d.h. alle relevanten Parameter und Bilddaten können über eine graphische Benutzeroberfläche (GUI) editiert und visualisiert werden.

|

| Abbildung 1: Graphische Entwicklungsumgebung für die Extraktion von verkehrsrelevanten Objekten |

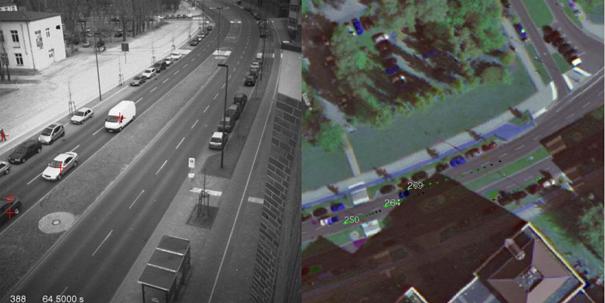

Für die flächendeckende und zeitversetzte Verfolgung von Verkehrsobjekten in großräumigen Gebieten mit verschieden positionierten optoelektronischen Sensoren erfolgt die Kombination der abgeleiteten Daten eines Sensors mittels Verfolgungsalgorithmen (Tracking). Zunächst wurde ein Kalmanfilter als Trackingansatz zur Verfolgung mehrerer Fahrzeuge innerhalb einer Videoszene gewählt. Dieses Kalman-Filter wurde anschließend für den Einsatz mehrerer Kameras angepasst. Durch den gewählten Ansatz ist eine Synchronisation der Aufnahmedaten nicht notwendig.

|

| Abbildung 2: Ergebnis des Multikameratrackings mithilfe des Kalman-Filters |

Ein weiterer wichtiger Aspekt war die Evaluation dieses auf dem Kalman-Filter basierenden Verfolgungsalgorithmus, der auch Grundlage für die Fusion von Objektdaten mehrerer Kamerasysteme ist. Dazu wurden verschiedene reale Verkehrsszenen untersucht und erste Simulationen durchgeführt. Die Verfolgung der Objekte erfolgt in Weltkoordinaten. Als Voraussetzung dafür wurden zuvor die äußere und wenn möglich auch die innere Orientierung der Kameras ermittelt.

|

| Abbildung 3: Objekterkennung und -verfolgung aus Daten realer Kamerasysteme (links). Projektion der Ergebnisse in ein Orthophoto (rechts) |

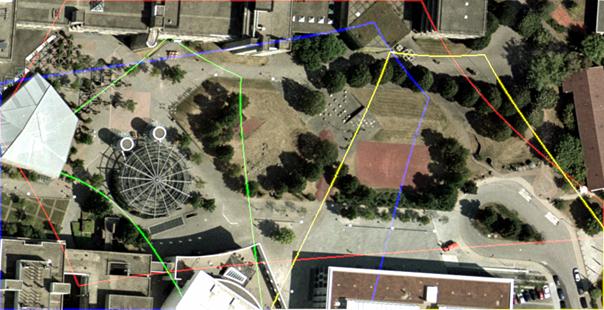

Für Multikamerasysteme ist die Bestimmung der gegenseitigen Orientierung der Kameras von besonderer Bedeutung. Als Beispiel soll hier ein Projekt zur Verfolgung von Personen auf einem Campus dienen. Dazu müssen die Orientierungsparameter von mehreren Kameras so bestimmt werden, dass die von ihnen gemessenen Weltkoordinaten im Überlappungsbereich nur geringe Abweichungen aufweisen. Dies wurde auf der Grundlage von Passpunkten, die aus Stereoluftbildern gewonnen wurden, realisiert.

|

| Abbildung 4: Überlappungsbereiche der Kameras und Überdeckung des Beobachtungs-Bereichs (Kamera 1 rot, Kamera 2 grün, Kamera 3 blau, Kamera 4 gelb) |

© 2026 - Computer Vision, Department of Computer Science, HU Berlin - - Legal Notice